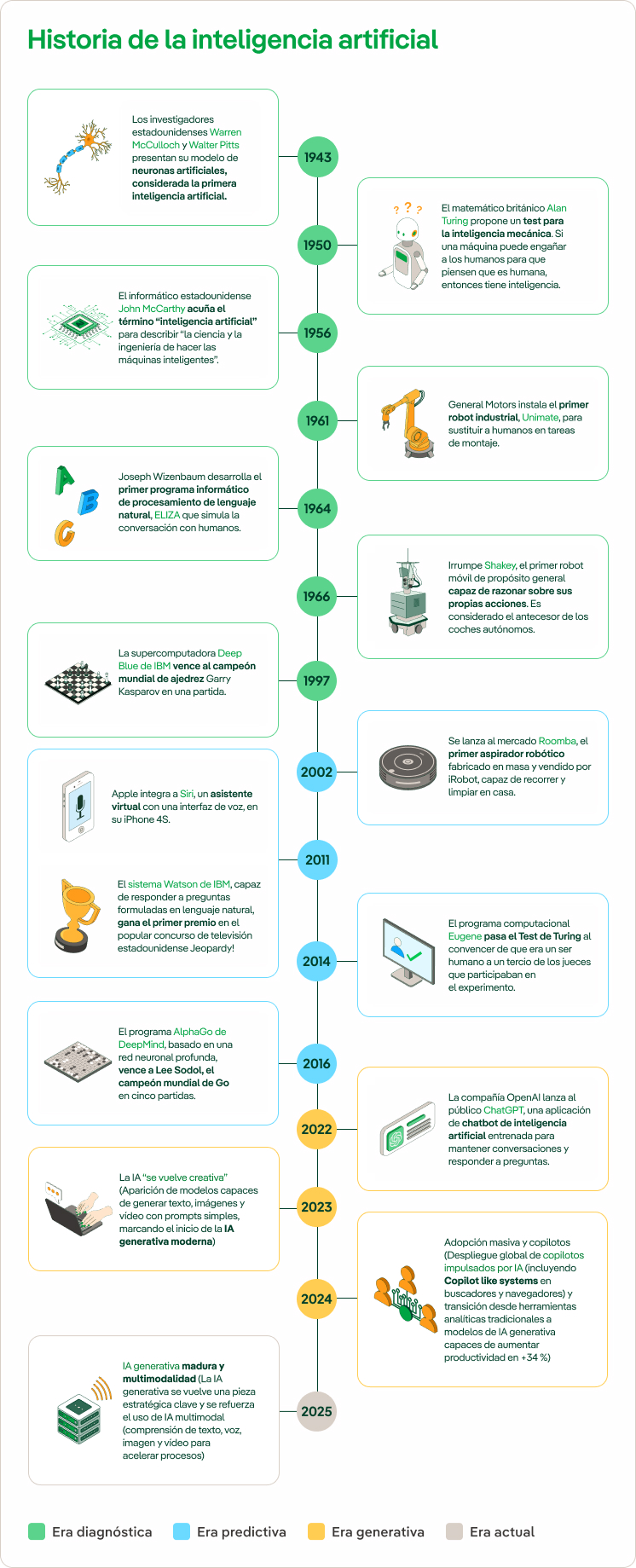

Historia de la inteligencia artificial

La inteligencia artificial: nacimiento, aplicaciones y tendencias de futuro

La inteligencia artificial (IA) es un campo que, aunque pueda parecer propio de películas futuristas, está profundamente arraigado en nuestra vida cotidiana. La idea de máquinas capaces de imitar la inteligencia humana es centenaria, pero en los últimos años ha avanzado de manera significativa. Hoy en día, la IA está presente en muchos aspectos de nuestra vida diaria, a menudo sin que lo notemos. Descubre qué es la inteligencia artificial, para qué sirve, cuáles son sus riesgos y desafíos y qué esperamos de ella en el futuro.

La inteligencia artificial ha emergido como una herramienta revolucionaria con aplicaciones cada vez más presentes en nuestra vida cotidiana. Desde la creación de robots con capacidades similares a las humanas hasta los asistentes virtuales que responden a comandos de voz en dispositivos móviles y altavoces inteligentes, la IA ha captado la atención de empresas globales en el sector de Tecnologías de la Información y las Comunicaciones (TIC). Considerada por muchos como la Cuarta Revolución Tecnológica, tras la expansión de las plataformas móviles y la computación en la nube, la IA está marcando una transformación profunda. Sin embargo, su desarrollo es el resultado de un largo proceso de avances científicos y tecnológicos que se remontan varias décadas atrás.

Definición y orígenes de la inteligencia artificial

Cuando hablamos de “inteligencia” en un contexto tecnológico a menudo nos referimos a la capacidad de un sistema para utilizar la información disponible, aprender de ella, tomar decisiones y adaptarse a nuevas situaciones. Implica una facultad de resolver problemas de manera eficaz, según las circunstancias y limitaciones existentes. Por su parte, el término “artificial” significa que la inteligencia en cuestión no es inherente a seres vivos, sino que se crea mediante la programación y el diseño de sistemas informáticos.

Como resultado, el concepto de “inteligencia artificial” (IA) alude a la simulación de procesos de inteligencia humana por parte de máquinas y programas informáticos. Estos sistemas están desarrollados para realizar tareas que, si las llevara a cabo el ser humano requerirían el uso de inteligencia, como el aprendizaje, la toma de decisiones, el reconocimiento de patrones y la resolución de problemas. Por ejemplo, gestionar enormes cantidades de datos estadísticos, detectar tendencias y aventurar recomendaciones según las mismas o, incluso, llevarlas a cabo.

Hoy en día, la Inteligencia no se dedica a crear conocimiento completamente nuevo, sino que se centra en recopilar, procesar y analizar datos para maximizar la eficiencia en la toma de decisiones. Los tres pilares fundamentales sobre los que se apoya la IA son:

- Los datos. Son la información que se recopila y organiza para que el sistema pueda automatizar tareas. Pueden incluir números, textos, imágenes, sonidos, entre otros tipos de datos.

- El hardware. Se refiere a la infraestructura de computación que posibilita el procesamiento de grandes cantidades de datos con rapidez y precisión, lo que permite la ejecución eficiente del software.

- El software. Consiste en algoritmos y modelos matemáticos que entrenan a los sistemas para reconocer patrones dentro de los datos, aprender de ellos y generar resultados que optimicen los procesos.

Pero, ¿qué son los algoritmos de la IA? Reciben este nombre las reglas que proporcionan las instrucciones para la máquina. Los principales algoritmos de la IA pueden ser aquellos que emplean la lógica, basados en los principios racionales del pensamiento humano, y los que combinan lógica o intuición (aprendizaje profundo o deep learning), que emplean el patrón de funcionamiento del cerebro de las personas para que la máquina aprenda tal y como lo harían ellas.

¿Cómo nació la inteligencia artificial?

La idea de crear máquinas que imitaran la inteligencia humana estaba presente incluso en la antigüedad, con mitos y leyendas sobre autómatas y máquinas pensantes. Sin embargo, no fue hasta mitad del siglo XX cuando se investigó su verdadero potencial, después de que se desarrollaran las primeras computadoras electrónicas.

En 1943 Warren McCulloch y Walter Pitts presentaron su modelo de neuronas artificiales, considerada la primera inteligencia artificial, aun cuando todavía no existía el término. Posteriormente, el matemático británico Alan Turing publicó en 1950 un artículo con el título “Computing machinery and intelligence” (“Maquinaria e inteligencia informática”) en la revista Mind donde se hacía una pregunta: ¿Pueden pensar las máquinas? Proponía un experimento que pasó a denominarse Test de Turing y que, según el autor, permitiría determinar si la máquina podría tener un comportamiento inteligente similar al de un ser humano o indistinguible de este.

John McCarthy acuñó en 1956 el término “inteligencia artificial” e impulsó en la década de 1960 el desarrolló del primer lenguaje de programación de IA, LISP. Los primeros sistemas de inteligencia artificial se centraron en reglas, lo que condujo al desarrollo de sistemas más complejos en las décadas de 1970 y 1980, junto a un impulso de la financiación. En estos momentos, la IA experimentó un renacimiento gracias a avances en algoritmos, hardware y técnicas de aprendizaje automático.

Ya en la década de 1990, los avances en la potencia informática y la disponibilidad de grandes cantidades de datos permitieron a los investigadores evolucionar algoritmos de aprendizaje y consolidar las bases de la IA del presente. En los últimos años, esta tecnología ha vivido un crecimiento exponencial, impulsado en buena medida por el desarrollo del aprendizaje profundo, que aprovecha redes neuronales artificiales con diversas capas para procesar e interpretar estructuras de datos complejas. Este desarrollo ha transformado significativamente diversas aplicaciones de la IA, como el reconocimiento de imágenes y voz, el procesamiento del lenguaje natural (PLN), y los sistemas autónomos, incluyendo vehículos autoconducidos y drones.

VER INFOGRAFÍA: Historia de la inteligencia artificial [PDF]

VER INFOGRAFÍA: Historia de la inteligencia artificial [PDF]

Beneficios de la Inteligencia Artificial en Sectores Clave: Casos de Uso y Ventajas para el Cliente

La inteligencia artificial desempeña un papel fundamental en la transformación digital y sostenible en diversos sectores. No solo crea un clima favorable para el desarrollo de un escenario digital cada vez más avanzado, sino que además es una de las tecnologías sostenibles con mayor impacto: permite reducir el número de equipos, recursos o materiales en las organizaciones o empresas. Presenta una mayor productividad con menos, lo que garantiza una base digital y sostenible para cualquier empresa.

La IA tiene aplicaciones prácticas en una amplia variedad de sectores, con un impulso en la eficiencia, la innovación y la toma de decisiones. Algunas de estas áreas son:

![]() Salud

Salud

La IA está transformando la salud mediante chatbots que recopilan síntomas para sugerir diagnósticos preliminares, mejorando la precisión con el uso de grandes volúmenes de datos clínicos. También está impulsando el desarrollo de tratamientos personalizados, analizando datos genéticos y médicos para crear terapias a medida, como en la medicina de precisión, que adapta los tratamientos a las características individuales de cada paciente.

![]() Finanzas

Finanzas

La tecnología inteligente permite evaluar riesgos y oportunidades, mejorando la toma de decisiones en inversiones y préstamos así como proporcionar asesoramiento financiero personalizado a través de asistentes virtuales.

![]() Educación

Educación

Existen plataformas educativas que emplean la IA para adaptar el contenido de aprendizaje según las necesidades individuales de los estudiantes. También permite simplificar tareas administrativas, como la corrección automática de exámenes.

![]() Agricultura

Agricultura

La IA analiza datos agrícolas para crear una agricultura de precisión optimizando el uso de recursos, mejorando la productividad y reduciendo el impacto ambiental. Además, drones y sensores basados en IA pueden monitorear el estado de los cultivos y ayudar a la detección temprana de enfermedades.

![]() Energía

Energía

Las aplicaciones de inteligencia artificial optimizan la distribución de energía, mejorando la eficiencia y la fiabilidad de las redes eléctricas, y permiten predecir fallos en equipo, reduciendo el tiempo de inactividad y el costo de mantenimiento.

![]() Logística y transporte

Logística y transporte

La IA juega un papel clave en el desarrollo de vehículos autónomos, así como en la optimización de las rutas de entrega y transporte, reduciendo costes y emisiones.

![]() Comercial

Comercial

Algunas aplicaciones de la inteligencia artificial permiten predecir las ventas futuras y seleccionar el producto más adecuado para recomendarlo a los clientes, optimizando tanto la toma de decisiones comerciales como la experiencia de compra.

Usos actuales de la inteligencia artificial (IA) en el sector energético

La inteligencia artificial está transformando el sector energético, optimizando la gestión de recursos, mejorando la eficiencia y reduciendo costos. Algunos de los principales usos actuales de la IA son:

-

Predicción de demanda: La IA permite anticipar el comportamiento del consumo energético, ajustando la producción y distribución de manera más precisa.

-

IA para gestión de activos: Facilita la monitorización y mantenimiento de los activos, optimizando su vida útil y reduciendo costos operativos mediante análisis predictivos.

-

IA para eficiencia en redes inteligentes: La IA optimiza el flujo de energía en las redes inteligentes, minimizando pérdidas y mejorando la calidad del servicio a los usuarios.

-

Uso de analítica avanzada en redes: Permite un análisis profundo de datos en tiempo real para mejorar la gestión de la red eléctrica, anticipando posibles fallos y mejorando la fiabilidad del servicio.

-

Modelos predictivos renovables (eólica y solar): La IA utiliza datos meteorológicos y de generación para predecir la producción de energía de fuentes renovables, integrándose de manera más eficiente a la red.

- Mantenimiento predictivo: Mediante algoritmos predictivos, la IA puede identificar posibles fallos en equipos y sistemas, permitiendo un mantenimiento preventivo que reduce tiempos de inactividad y costos.

Riesgos y desafíos asociados a la inteligencia artificial

Los avances en la inteligencia artificial han provocado la transformación de diversas áreas y sectores, pero también han suscitado preocupaciones sobre posibles riesgos o desafíos que puedan surgir en su desarrollo. Estos son algunos ejemplos:

![]() Sesgos y discriminación algorítmica

Sesgos y discriminación algorítmica

La IA se basa en algoritmos y datos para tomar decisiones, pero estos pueden estar sesgados y perpetuar injusticias. Estos pueden reflejar y amplificar sesgos existentes, lo que podría llevar a decisiones discriminatorias.

![]() Violación de la privacidad

Violación de la privacidad

La recopilación y el análisis de grandes cantidades de datos para alimentar algoritmos de IA puede plantear preocupaciones sobre la privacidad de la información de las personas si no se manejan adecuadamente. Las violaciones de datos pueden favorecer incluso la proliferación de posibles ataques cibernéticos.

![]() Desplazamiento laboral

Desplazamiento laboral

La IA y la automatización también pueden suponer un riesgo de desplazar a millones de trabajadores de sus empleos. Las tareas repetitivas y rutinarias pueden ser fácilmente asumidas por sistemas de IA avanzados, lo que podría llevar al desempleo masivo en algunos sectores, lo que plantea desafíos económicos y sociales.

![]() Seguridad

Seguridad

La IA también puede ser utilizada con fines maliciosos, como para el desarrollo de ataques cibernéticos más sofisticados y menos conocidos para las víctimas.

![]() Ética y responsabilidad legal

Ética y responsabilidad legal

Las decisiones motivadas por los algoritmos pueden plantear cuestiones éticas, especialmente cuando se tratan de situaciones críticas, como la atención médica, la justicia y la seguridad. A esto se une la dificultad de determinar la responsabilidad legal en caso de decisiones incorrectas o acciones perjudiciales de sistemas de IA.

![]() Superinteligencia y control

Superinteligencia y control

Algunos expertos han planteado preocupaciones sobre un posible riesgo asociado con el desarrollo de una IA superinteligente a largo plazo. El principal temor se basa en que si llegamos a crear una IA con una inteligencia superior a la humana, podría volverse autónoma y superar nuestra capacidad de control.

Consumo de energía

Consumo de energía

Los modelos de IA, especialmente los más complejos, requieren una gran cantidad de poder computacional para entrenarse y operarse. Esto se traduce en un elevado consumo de energía, que puede contribuir a la huella de carbono, especialmente si los centros de datos no utilizan fuentes de energía renovable.

Mirando hacia el futuro: tendencias y proyecciones de la IA

La ética de la IA seguirá siendo una preocupación central, enfocándose en garantizar que los sistemas sean justos, equitativos y respeten la privacidad de los usuarios. En este contexto, la IA explicativa (XAI) se está volviendo crucial para aumentar la transparencia y la confianza en los sistemas automatizados.

A medida que la IA evoluciona, se especializa cada vez más en áreas como la salud personalizada, con tratamientos adaptados a las necesidades individuales basados en datos genéticos, y la educación, donde se crearán herramientas de aprendizaje más inclusivas y adaptativas.

La convergencia de la IA con tecnologías emergentes como la computación cuántica, que promete mejorar la velocidad y capacidad de procesamiento de datos, y la robótica avanzada, permitirá desarrollar sistemas autónomos más eficaces en áreas como la logística y la atención sanitaria. Además, la inteligencia artificial generativa, que incluye herramientas como los modelos de lenguaje avanzados, está empezando a revolucionar sectores como la creación de contenido, la programación y el diseño creativo.

Conforme la Inteligencia Artificial se va expandiendo, es esencial establecer marcos regulatorios globales para garantizar su uso ético y responsable, protegiendo tanto a los consumidores como a las empresas. La IA debe integrarse de manera que maximice sus beneficios y minimice sus riesgos, especialmente en términos de privacidad, sesgo algorítmico y sostenibilidad.